随着互联网内容日益丰富,内容审核的需求也在不断增长。尤其是在社交媒体、在线视频平台以及电子商务等领域,内容监管变得尤为重要。尤其是在内容审核领域,鉴黄师的工作至关重要。由于技术的限制,许多自动检测系统在判断恶性内容时,常常出现误判问题,造成了严重的后果。在这种背景下,如何优化自动检测系统,提升判断的准确性,成为行业内的一个关键课题。

近年来,自动化技术在内容审核领域取得了显著进展,尤其是在恶性内容的检测上,许多平台已经依赖人工智能(AI)和机器学习(ML)技术来进行初步筛查。虽然这些技术能够迅速筛选大量数据,但它们并非完美,仍然存在较高的误判率,尤其是在细微行为判断方面。许多情况下,系统在进行恶性内容识别时,未能准确识别某些边界模糊的行为,导致一些合法内容被错误判定为不良内容,影响了用户体验。

为了减少误判,许多平台开始引入人工审核和机器审核的结合模式。即系统首先进行自动检测,当检测到潜在问题时,人工审核员介入,做出最终判断。尽管这种模式提高了内容审核的准确性,但在实际操作中,如何平衡自动检测与人工判断之间的权重,仍然是一个难题。人工判断往往会受到个人经验、情绪以及审查标准不一致等因素的影响,因此需要通过一系列数据分析,找出并调整自动检测系统中的“误判”原因。

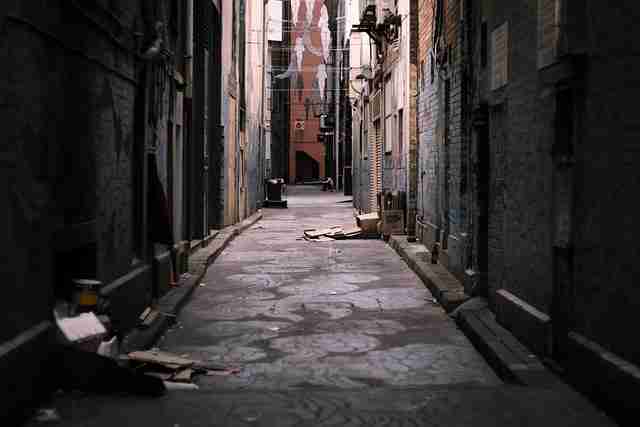

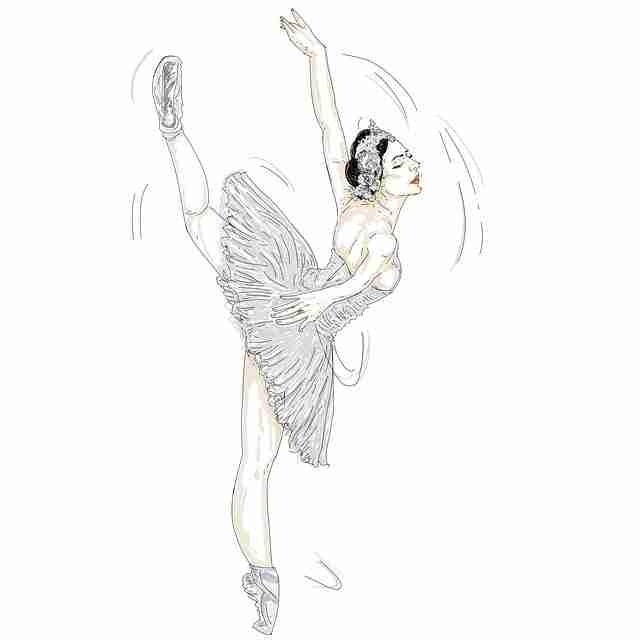

为了解决这一问题,许多平台开始采用“行为误判数据还原”的方法,通过回溯并分析误判数据,从源头上找出问题并进行改进。具体来说,平台首先会收集大量的误判数据,然后通过数据分析还原出误判的原因,找出自动检测系统判断错误的具体环节。这一过程不仅需要对错误的判断进行详细记录,还需要结合人工审核员的反馈,以确保系统在未来能够更准确地识别恶性内容。例如,某些图片或视频可能因为穿着、背景、拍摄角度等因素被误判为不良内容,实际上它们并不违反平台规定。通过还原这些误判数据,平台可以识别出这些问题,并针对性地调整算法,提高准确性。

通过数据还原,平台还可以评估自动检测系统中不同算法的效果。许多平台使用不同的检测算法,包括图像识别、文本分析、行为监测等,这些算法可能在某些情况下表现优异,而在另一些情况下则存在明显的局限性。通过分析误判数据,平台能够发现哪些算法在特定类型的内容识别中存在问题,进而进行优化和调整。尤其是在涉及细节和上下文的判断时,往往需要更复杂的算法来理解内容的真实意图。

除了行为误判数据的还原,另一个重要的优化方法是调整人工判断与自动检测的权重。人工审核和自动检测相结合的模式,虽然能够有效地减少误判,但如果人工审核权重过大,容易造成审查效率的低下,影响平台的内容更新速度;而如果自动检测权重过大,又容易导致误判率的上升,影响用户体验。因此,如何合理地调整这两者的权重,成为了内容审核中不可忽视的一个难题。

为了有效地调整权重,许多平台通过对人工判断和自动检测的实时数据进行监控与分析,找出了最合适的平衡点。在初步检测阶段,自动检测系统负责对内容进行快速筛查,尽可能减少人工审核员的负担。这不仅能够提高审核效率,还能够让人工审核员集中精力审查更为复杂的内容。系统还可以根据不同类型的内容和用户行为来动态调整人工判断的权重。例如,对于某些特定的内容类型,如成人内容、暴力信息等,自动检测系统可能会赋予更高的权重,因为这些内容具有明显的特征和标准。而对于一些边界模糊、需要语境判断的内容,人工判断可能会占据更高的权重,以确保判断的准确性。

平台还可以通过定期的人工与自动判断效果对比,进行数据分析,进一步优化权重设置。这种方法的好处在于,平台可以通过数据反馈实时调整算法和审核流程,确保系统的高效性与准确性。例如,某些用户可能因为行为习惯问题(如频繁查看敏感内容)导致某些内容被误判,而人工审核员通过经验可以有效判断是否为误判。通过这种方式,平台不仅能够提高检测准确性,还能够避免因过度依赖自动检测而引发的误判问题。

在未来,随着人工智能技术的不断发展,自动检测系统的能力将不断提升。即便如此,人工判断的作用仍然不可忽视。通过结合误判数据的还原与合理调整权重设置,平台能够在提高效率的减少误判,保证用户体验,最终实现更加智能、高效的内容审核系统。

鉴黄师在内容审核中发挥着举足轻重的作用,而自动检测系统与人工判断相结合的模式,正是解决误判问题的关键。通过行为误判数据的还原与权重重设,平台可以实现更精准、更高效的内容审核,为用户提供一个更安全、更友好的在线环境。这一过程不仅需要技术的支持,更需要持续的优化与调整,才能在日益复杂的内容生态中应对各种挑战。